大模型训练 个人定制LORA

等服务内容

24K 订阅

个人定制LoRA(低秩适配)服务中,用户可通过高效微调技术实现大模型的个性化定制,以下从服务流程、技术优势、应用场景、核心工具.

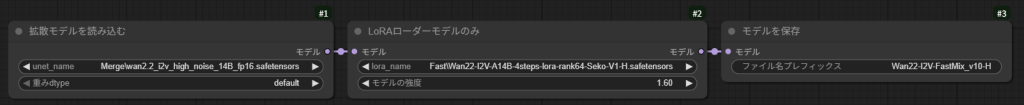

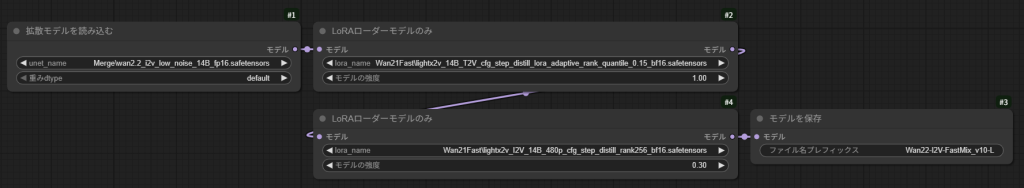

导出模型时选择通用格式(如Hugging Face模型格式),便于长期保存和跨平台迁移.

导出模型时选择通用格式(如Hugging Face模型格式),便于长期保存和跨平台迁移.

Wan 2.2 I2V-A14B, 6steps/generation. apache-2.0.使用 Q4_K_M 与 Geforce RTX 3060 12GB 配合使用。有关不同量化的参数,请参阅 HuggingFace。

EasyWan22 FastMix (Wan 2.2 I2V-A14B)

Wan 2.2 I2V-A14B, 6steps/generation. apache-2.0.

使用 Q4_K_M 与 Geforce RTX 3060 12GB 配合使用。

有关不同量化的参数,请参阅 HuggingFace。

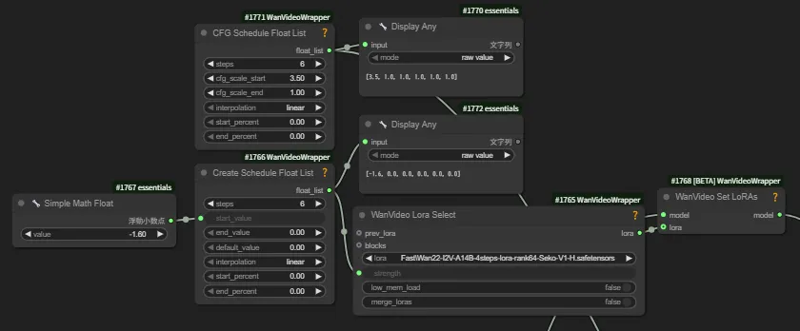

lcm511, 0.94, 0.85, 0.73, 0.55, 0.28, 06, start_step: 0, end_step: 31truemouth moving, 嘴在动, talking, 说话, speaking, 讲话,

Generation

lcm511, 0.94, 0.85, 0.73, 0.55, 0.28, 06, start_step: 31mouth moving, 嘴在动, talking, 说话, speaking, 讲话,SeedGacha SSR Video > Upscale x1.5 & Encode samples

lcm511.0, 0.97, 0.94, 0.90, 0.85, 0.795, 0.73, 0.65, 0.55, 0.42, 0.28, 0.14, 0.012, start_step: 10true1mouth moving, 嘴在动, talking, 说话, speaking, 讲话,